Le domande davanti ai dati cambiano con l'intelligenza artificiale?

Questione di flussi di responsabilità

Grazie alle persone che hanno fatto girare il numero precedente, e il video dove lo riassumo. Devo ancora rispondere a molti commenti, prometto di farlo entro fine settimana. Grazie al commento di Michele, che su Instagram mi ha confermato quanto l’analogia tra le ondate di calore e la classificazione dei femminicidi sia stata particolarmente azzeccata. Una precisazione: quando ho scritto che la statistica è una scienza politica in realtà intendevo dire che è una scienza al servizio delle decisioni politiche. Ho cercato nel mio telefono le note dove avevo preso appunti quando ho ascoltato Enrico Bisogno, statistico delle Nazioni Unite, spiegarlo così bene, ma non le ho più trovate e ho usato una formula che sembrava uno slogan, ma non era la mia intenzione in quel passaggio.

In questo numero: torniamo alle basi grazie a uno spunto di Stefano Gatti che ha ripreso le mie cinque domande sui dati.

Dove mi trovi prossimamente

23 maggio, Scalea (CS): alle 18 presento il libro “Perché contare i femminicidi è un atto politico” presso l’associazione Eclectica, a Villa Giordanelli.

25 maggio, Genova: alle 11 nell’ambito del programma “Come stiamo cambiando con l’IA”, partecipo a un appuntamento promosso da Fondo per la Repubblica Digitale e da Acri.

26 maggio, Roma: con gioia presento il libro di Chiara Alessi “La sedia del sadico” (Laterza) al museo MAXXI.

Cosa ho scritto (o cosa ho detto)

Per SkyTg24 parlo del desiderio di bambini e bambine di riprendersi la città con le loro biciclette, anche a partire dai dati di Clean Cities Urban Mobility Barometer 2026.

Per Internazionale nell’ultima newsletter (per abbonati) racconto di uno studio che ha stimato le perdite economiche che derivano dall’attacco alla credibilità delle statistiche nazionali.

Sei tra le 14900 persone che leggono la newsletter. Nell’ultima puntata abbiamo cercato di capire come si misurano i fenomeni sociali, e non solo. A partire dal femminicidio.

Le potenzialità enormi degli algoritmi e degli strumenti di intelligenza artificiale possono portare a fare eccessivo affidamento sui dati, implicando una svalutazione del ruolo del decisore, un rallentamento del processo decisionale e in alcuni casi anche un’eccessiva attenzione all’ottimizzazione.

Stefano Paleari, Lucio Cassia, Matteo Kalchschmidt, Un dato di fatto (Francesco Brioschi ed. 2021)

Le 5 (+5) domande sui dati (e sull’IA)

Intanto, una confessione: davanti alla prospettiva di capire se le intelligenze artificiali siano macchine senzienti, io mi tiro indietro. Non lo trovo abbastanza interessante, e da figlia di un programmatore dentro i computer io ci vedo… altri computer. Credo anzi che mitizzare le macchine attribuendo loro comportamenti umani sia un ostacolo all’alfabetizzazione. Mi ricordo un incontro in una biblioteca della Brianza, piena, pienissima, sul mio libro Dentro l’algoritmo (effequ 2022). Alla fine mi si avvicina un signore, un esperto di letteratura dell’ottocento, che aveva usato ChatGpt per un’analisi dei Promessi sposi. Era molto spaventato dai risultati accurati che la macchina aveva fornito: “non può essere solo merito del codice!”.

Uno dei libri più appassionanti che ho letto sul tema, anzi che abbiamo letto con il Data Book Club, è stato “Macchine ingannevoli”, di Simone Natale (Einaudi 2022), dove lo storico e teorico dei media svela l’inganno banale della tecnologia radicato nella nostra tendenza a "socializzare" con le macchine, e a lasciarci “stupire” dalla loro apparenza umana. Per Natale, l’intelligenza delle macchine non può essere riconosciuta in termini assoluti, ma soltanto dal punto di vista degli esseri umani che la osservano e ci interagiscono.

Quindi, come davanti ai dati, che “non sono niente di speciale”, anche quando leggiamo le risposte di un’IA dovremmo ricordare che stiamo osservando token1 generati tramite una previsione statistica del termine successivo più probabile, calcolata su enormi distribuzioni linguistiche.

Nella sua ultima newsletter Stefano Gatti riprende il mio elenco di domande da porsi quando vediamo una notizia che contiene dei dati:

Da dove arrivano i dati?

Che tipo di metodologia è stata usata?

Cosa dicono (in più) i metadati

Cosa stiamo contando?

Cosa non dicono questi dati

Adottando l’approccio del femminismo dei dati nel tempo ho aggiunto:

Con quale obiettivo sono stati raccolti

Chi li ha prodotti

A danno o a beneficio di chi

Chi era nella stanza quando sono state prodotte le domande di indagine (cfr Deborah Stone).

Ora, Stefano Gatti ne propone un’altra, legata al ruolo dell’intelligenza artificiale:

Chi si è preso la responsabilità finale di controllare fatti, link e interpretazione? Se la risposta è “nessuno, ha fatto tutto la macchina”, io un passo indietro lo farei.

Le domande sono diventate dieci.

Ma come si sviluppa quella responsabilità nel momento in cui sempre più cataloghi open data pubblici saranno interrogabili con l'IA?

Dove inizia e dove finisce la responsabilità di chi ha curato quei cataloghi, ha costruito i percorsi, ha prodotto i metadati e ha poi lasciato la navigazione all'utente? Non si rischia di saltare alcuni passaggi?

Di questo ne stiamo discutendo dentro l’Associazione onData, perché diversi soci hanno cominciato a sperimentare un collegamento tra i dati statistici dell’Istat a un agente di intelligenza artificiale attraverso i server MCP (Model Context Protocol) uno standard che permette ai modelli di linguaggio di dialogare direttamente con banche dati esterne. Ne ha scritto Andrea Borruso nell’ultima newsletter. Il risultato è che invece di navigare manualmente la piattaforma IstatData o Esplora Dati, cercare il dataset giusto, leggere la documentazione, filtrare le variabili, si può semplicemente chiedere "quali sono i dati Istat sulle coltivazioni agricole?" e ottenere una risposta. L'interfaccia scompare, rimane la domanda e arriva la risposta, se tutto va come previsto. Ed è un ottima possibilità per rintracciare dataset per cui sarebbero stati necessarie decine di click per trovarli e scaricarli.

Ma qui la responsabilità si distribuisce su una catena più lunga e meno visibile: chi ha prodotto i dati, chi ha curato il catalogo, chi ha costruito il server MCP, chi ha formulato la domanda. E, quando qualcosa non torna, un dato mancante, una categoria sbagliata, un'interpretazione fuorviante, per capire dove si è rotto il passaggio bisogna risalire tutta quella catena. Il che è possibile, ma richiede una consapevolezza e un’intenzionalità che deve avere come base un insieme di competenze sui dati su cui bisogna allenarsi parecchio.

Magari partendo semplicemente dalle prime 5 domande.

La dataviz della settimana

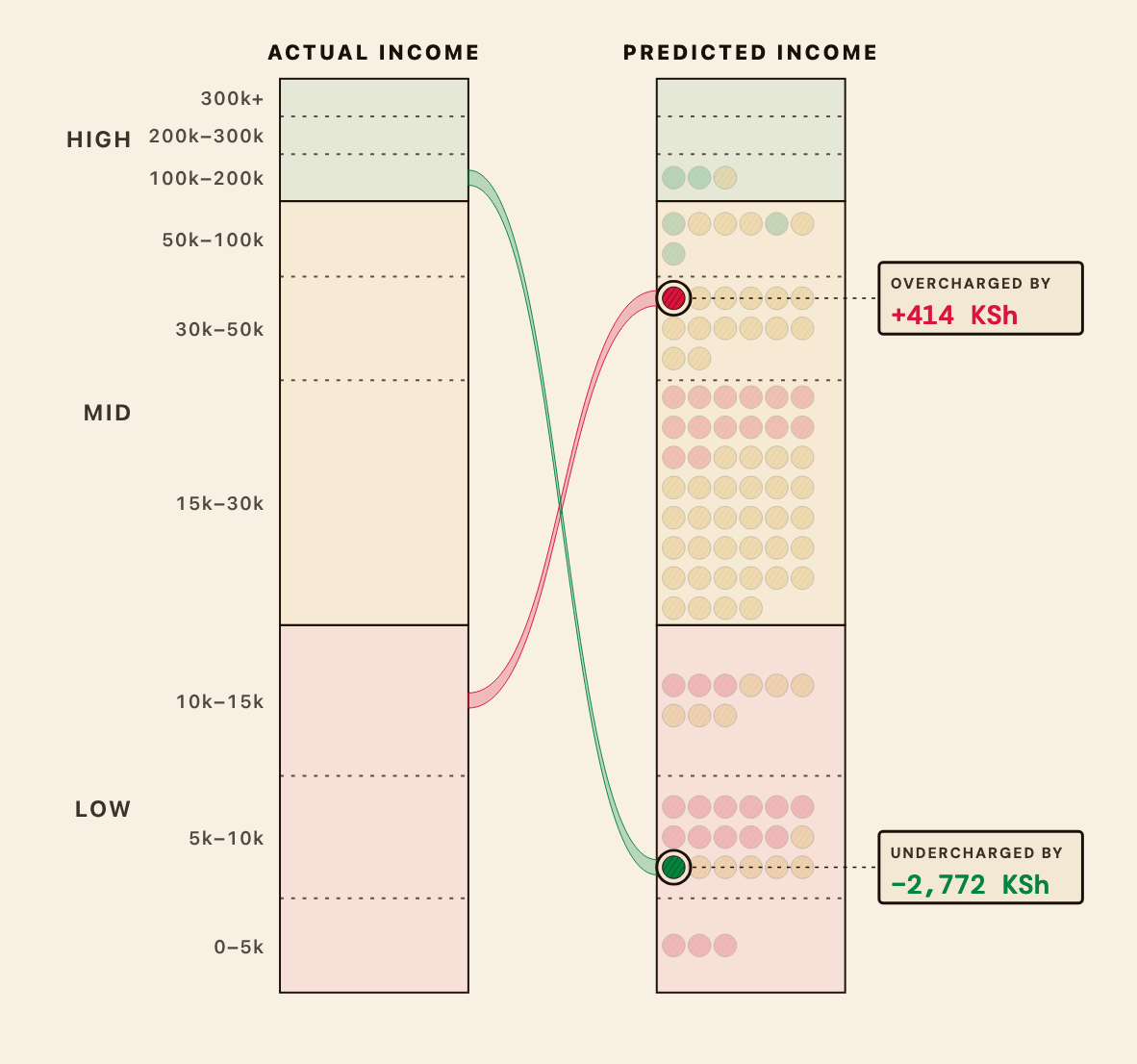

Un bel lavoro interattivo che mostra le disuguaglianze di un sistema di IA usato in Kenya per calcolare i contributi sanitari dei cittadini. L’algoritmo stima il reddito delle famiglie attraverso variabili indirette, materiale del tetto delle abitazioni, tipo di toilette, possesso di una radio, ecc., e calcola in base a quello il premio assicurativo annuo. Il problema è che il modello sovrastima sistematicamente i redditi dei poveri e sottostima quelli dei ricchi, e i giornalisti hanno scoperto che si trattava di una scelta deliberata, a proposito di responsabilità. Se volete leggere un pezzo in italiano sul tema ne ha scritto Francesca Sibani su Internazionale.

Grazie di aver letto fino a qui, ci sentiamo mercoledì prossimo!

Un token è un’unità di informazione elaborata dal modello, un blocco di testo, una parte di parola o una parola intera.